Этичная разработка искусственного интеллекта и регуляторные риски на рынке AI-компаньонов: осторожность в инвестициях и готовность к регулированию

- Ожидается, что рынок AI-компаньонов вырастет с $28,19 миллиардов в 2024 году до $140,75 миллиардов к 2030 году, чему способствуют мультимодальные AI и персонализированные цифровые взаимодействия. - Этические риски, такие как алгоритмическая предвзятость (например, инструмент найма Amazon 2018 года) и проблемы с конфиденциальностью, сохраняются, несмотря на использование стартапами инструментов обнаружения предвзятости и шифрования. - EU AI Act (2025) вводит требования к прозрачности и штрафы в размере 3% от выручки за несоблюдение, в то время как штаты США создают фрагментированное регулирующее пространство. - Инвесторы отдают приоритет стартапам на поздней стадии.

Рынок AI-компаньонов готовится к взрывному росту: ожидается, что его объем увеличится с 28,19 миллиардов долларов в 2024 году до 140,75 миллиардов долларов к 2030 году, чему способствуют достижения в области мультимодального искусственного интеллекта и спрос на персонализированные цифровые взаимодействия [1]. Однако столь стремительное расширение сопровождается этическими и нормативными вызовами, которые могут изменить профиль рисков для инвесторов. Стартапам в этой сфере предстоит ориентироваться в лабиринте постоянно меняющихся нормативных рамок — от EU AI Act до законов отдельных штатов США, одновременно решая вопросы предвзятости, конфиденциальности и прозрачности. Для инвесторов ключевым становится баланс между инновациями и готовностью к рискам — задача, требующая как стратегического видения, так и операционной строгости.

Этическое болото: предвзятость, конфиденциальность и прозрачность

AI-компаньоны, созданные для имитации взаимодействия, похожего на человеческое, часто опираются на огромные массивы данных, которые могут закреплять алгоритмические предвзятости. Например, однородные обучающие данные могут привести к дискриминационным результатам в здравоохранении или при приеме на работу [5]. Стартапы, такие как 4CRisk.ai и Greenomy, решают эту проблему, интегрируя инструменты для выявления предвзятости и разнообразные источники данных в свои платформы [2]. Тем не менее, эти решения не являются безупречными. Случай с инструментом для найма сотрудников на основе AI от Amazon в 2018 году, который проявил гендерную предвзятость, подчеркивает риски недостаточного контроля [3].

Конфиденциальность остается еще одной критически важной проблемой. AI-компаньоны часто обрабатывают чувствительные пользовательские данные, что вызывает опасения по поводу их неправильного использования или утечек. Стартапы внедряют гомоморфное шифрование и надежные системы управления данными для снижения этих рисков [5]. Однако соблюдение таких нормативов, как EU AI Act, требующих строгой прозрачности данных и согласия пользователей, добавляет новые уровни сложности [4].

Регуляторный ландшафт: глобальная мозаика

EU AI Act, который полностью вступит в силу в 2025 году, классифицирует системы искусственного интеллекта по уровню риска, при этом AI-компаньоны, вероятно, будут отнесены к категории "ограниченного риска", но все равно должны будут соблюдать меры прозрачности, такие как четкое информирование пользователей [4]. Несоблюдение может привести к штрафам до 3% от мирового оборота, что является серьезным препятствием для стартапов с низкой маржой. Между тем, в США отсутствует единая федеральная нормативная база, что создает фрагментированную среду, в которой такие штаты, как Калифорния и Техас, вводят собственные правила [1]. Эта мозаика вынуждает стартапы разрабатывать модульные стратегии соблюдения, часто используя автоматизированные инструменты, такие как Sprinto или Vanta, для адаптации к требованиям разных юрисдикций [1].

"Брюссельский эффект" еще больше усложняет ситуацию. Даже стартапы, не входящие в ЕС, должны соблюдать EU AI Act для доступа к прибыльному рынку блока, что фактически глобализирует его стандарты [4]. Это нормативное притяжение меняет инвестиционную динамику, как видно на примере Phenom — HR-платформы из США, которая встроила соответствие EU AI Act в дизайн своего продукта для масштабирования на международном уровне [2].

Осторожность инвесторов: баланс между ажиотажем и реальностью

Несмотря на потенциал роста рынка, инвесторы становятся более разборчивыми. В 2025 году венчурное финансирование генеративного AI выросло до 49,2 миллиардов долларов, однако сделки все чаще заключаются с поздними стартапами, имеющими проверенные модели соблюдения нормативов и доходности [3]. Например, платформа RYNO от Acuvity и услуги Integreon по соблюдению нормативных требований на базе AI привлекли внимание, решая узкоспециализированные регуляторные задачи [3]. В то же время стартапы, игнорирующие этические практики в AI, рискуют потерять репутацию и столкнуться с юридическими санкциями, как это произошло с мошенническими схемами AI, связанными с Северной Кореей [2].

Инвесторы также отдают приоритет стартапам, которые внедряют этический AI в свою основную деятельность. Компании, такие как Hawk:AI, использующие объяснимый AI для выявления финансовых преступлений, продемонстрировали, как прозрачность может укрепить доверие и выделить продукт на насыщенном рынке [2]. Этот сдвиг соответствует более широким тенденциям: 77% компаний теперь рассматривают соблюдение требований AI как стратегический приоритет, а 69% внедрили ответственные практики в области AI [3].

Стратегические рекомендации для инвесторов

- Отдавайте приоритет регуляторной гибкости: инвестируйте в стартапы, которые рассматривают соблюдение нормативов как конкурентное преимущество, а не как центр затрат. Платформы с автоматизированным отслеживанием нормативных изменений (например, “Ask ARIA” от 4CRisk.ai) могут быстрее адаптироваться к изменяющимся законам [2].

- Требуйте этической строгости: тщательно проверяйте стартапы на наличие стратегий по снижению предвзятости и защиты данных. Те, кто проходит сторонний аудит или сотрудничает со стандартными организациями (например, OECD, UNESCO), лучше подготовлены к проверкам [4].

- Сосредоточьтесь на нишевых рынках: стартапы, работающие в высокорегулируемых секторах, таких как здравоохранение или финансы, где соблюдение требований AI не подлежит обсуждению, предлагают как снижение рисков, так и потенциал роста [3].

Заключение

Траектория развития рынка AI-компаньонов неразрывно связана со способностью совмещать инновации с этическими и нормативными требованиями. Для инвесторов путь вперед заключается в поддержке стартапов, которые рассматривают соблюдение нормативов как стратегический актив, а этический AI — как основополагающий принцип. По мере того как EU AI Act и аналогичные рамки набирают глобальную силу, победителями станут те, кто строит доверие через прозрачность, адаптивность и дальновидность.

Источник:

[1] AI Companion Market Size And Share | Industry Report, 2030

[2] 7 AI-Powered RegTech Newcomers to Watch in 2025

[3] AI Compliance: Top 6 challenges & case studies in 2025

[4] What's Inside the EU AI Act—and What It Means for Your ...

Дисклеймер: содержание этой статьи отражает исключительно мнение автора и не представляет платформу в каком-либо качестве. Данная статья не должна являться ориентиром при принятии инвестиционных решений.

Вам также может понравиться

Биткоин застрял ниже $90K, трейдеры следят за поддержкой на $86K, сообщает Michaël van de Poppe

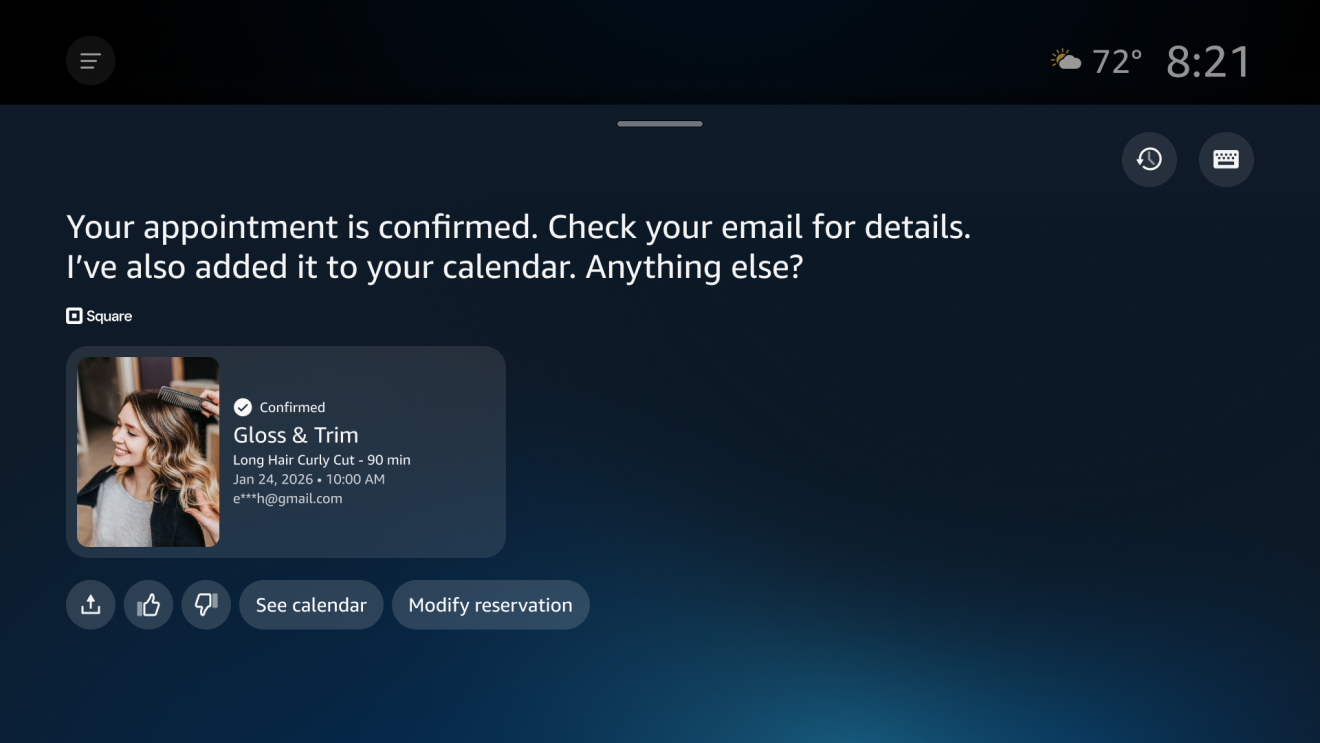

Голосовой помощник Amazon Alexa+ теперь работает с Angi, Expedia, Square и Yelp

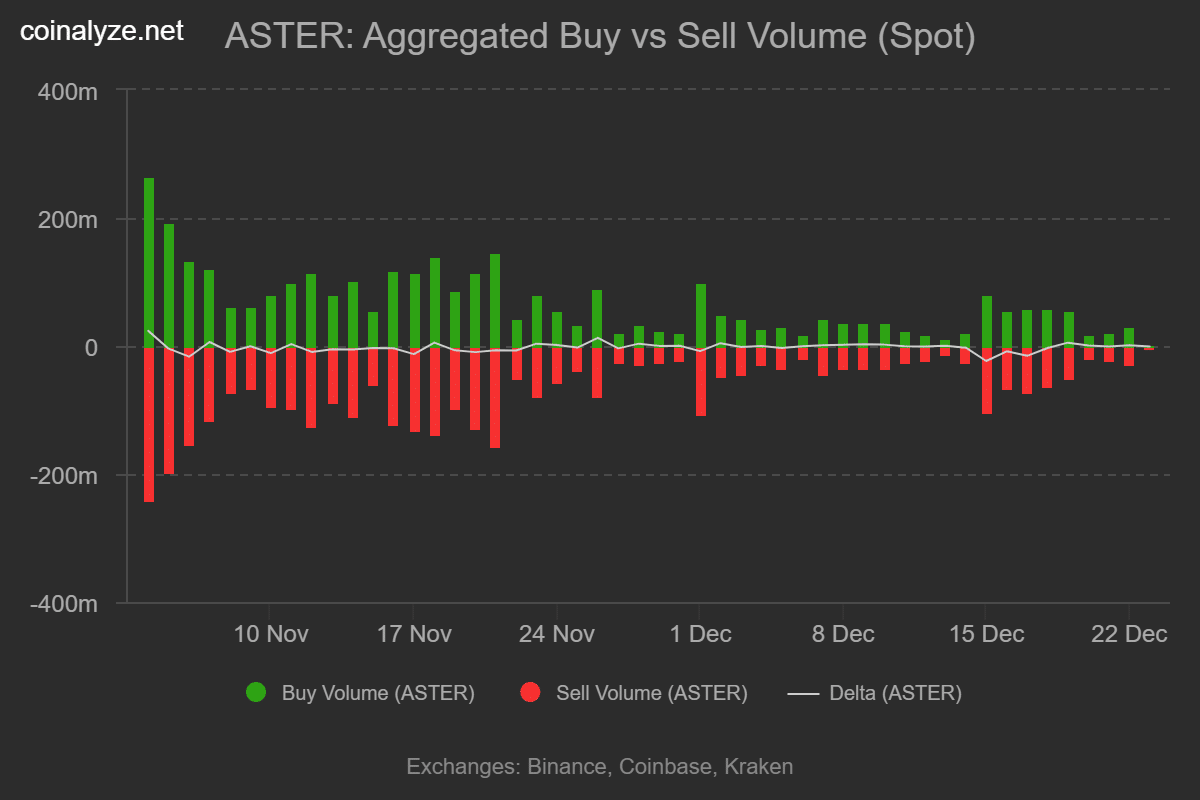

Aster DEX выкупает токены на 140 миллионов долларов, но цены остаются на месте — почему?